今年以来,AI大模型成为科技公司竞争焦点,国内外企业都投身大模型训练中,日前Meta宣布开源了Llama2大语言模型,最高700亿参数,还支持免费商用,引发业界关注,但部署如此规模的大模型对开发者来说并不容易,阿里云率先支持Llama2全系列训练部署。

7月25日,阿里云宣布在国内率先推出针对Llama2全系列版本的训练和部署方案,欢迎所有开发者来阿里云上打造专属大模型。

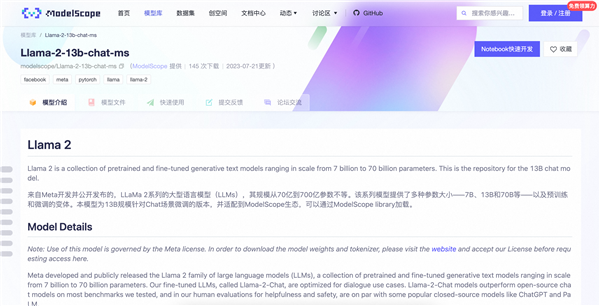

近日,Llama2大语言模型宣布开源,覆盖70亿、130亿及700亿参数版本。Llama2可免费用于研究场景和月活7亿用户以下的商业场景,为企业和开发者提供了大模型研究的新工具。

然而,对Llama2的再训练和部署仍存在较高门槛,尤其是针对效果更胜一筹的大尺寸版本。

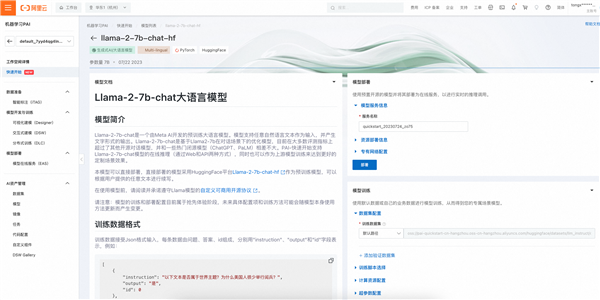

为方便开发者群体,阿里云机器学习平台PAI在国内率先对Llama2系列模型进行深度适配,推出了轻量级微调、全参数微调、推理服务等场景的最佳实践方案,助力开发者快速基于Llama2进行再训练,搭建自己的专属大模型。

阿里云牵头发起的AI模型社区魔搭ModelScope,第一时间上架了Llama2系列模型。开发者可在魔搭社区Llama2模型页面点击“Notebook快速开发”,一键拉起阿里云机器学习平台PAI,对模型进行云上开发和部署;在其他平台下载的Llama2模型,也可使用阿里云PAI进行开发。

针对特殊的场景需求,开发者往往需使用微调训练的方法对模型进行“调整”,以获得特定领域的专业能力和知识。

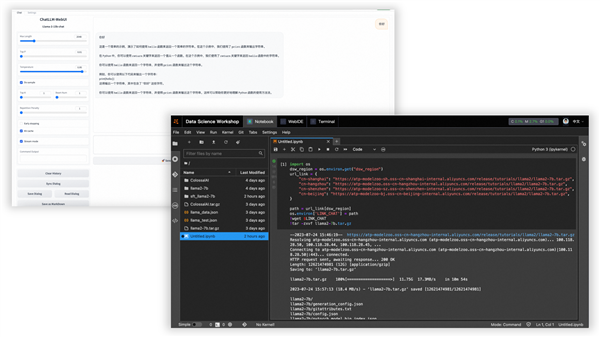

此时,PAI支持开发者在云上进行轻量级Lora微调或更深度的全参数微调。完成模型微调后,PAI支持开发者通过Web UI及API的方式部署Llama2,使模型可以通过网页或嵌入应用与使用者交互。

相比本地单机训练Llama2,在阿里云上可完成对超大尺寸模型的深度开发,且预置环境免运维,操作简单便捷,同时开发者可获得丰富的AI计算资源和极致弹性。

本地单卡GPU只能完成Llama2 70亿参数版本的轻量级Lora微调和推理,更大尺寸版本及更深度训练均很难支撑。

在阿里云上,通过PAI灵骏智算服务提供的分布式计算能力,可对Llama2全尺寸版本进行轻量级和全参数微调,并进行高效部署和推理。

作为全球前三、亚洲第一的云厂商,阿里云是中国AI浪潮重要的引领者和服务者,已构建完备的IaaS+PaaS+MaaS一体化AI服务。

在基础设施层,阿里云拥有国内最强的智能算力储备,灵骏智算集群具备最大十万卡GPU规模扩展性,可承载多个万亿参数大模型同时在线训练;

在AI平台层,阿里云机器学习平台PAI提供AI开发全流程的工程能力,PAI灵骏智算服务支撑了通义千问等超大模型的训练和应用,可将大模型训练性能提高近10倍,推理效率提升37%;

在模型服务层,阿里云构建了国内最活跃的AI模型社区魔搭,并支持企业基于通义千问或三方大模型进行再训练。

今年7月初,阿里云宣布,将把促进中国大模型生态的繁荣作为首要目标,向大模型创业公司提供包括模型训练、推理、部署、精调、测评、产品化落地等在内的全方位服务,并在资金和商业化探索方面提供充分支持。